Entropie

Aus Daimon

(pch) Entropie ist ein Fachwort aus Physik und aus Informatik. Umgangssprachlich dient es dazu, den Anblick zu beschreiben, den der Schreibtisch Ihres Autors bietet. Die ersten zwei Verwendungen des Wortes können zueinander in Bezug gebracht werden, letztere mit beiden anderen nicht.

Wegen seines ausgeprägten Ordnungssinnes hatte man den Maxwell’schen Dämon als Mädchen für alles eingestellt.

Der zweite Hauptsatz der Thermodynamik behauptet, dass Energie dazu neigt sich in der Umgebung zu verlieren anstatt Arbeit zu verrichten. Der Wert dieses Satzes besteht nicht zuletzt darin, dass er es erlaubt, zukünftige Ereignisse vorherzusagen. Das umfasst recht banale Aussagen wie die, dass Kaffee und Milch in einer Tasse mischen, oder dass das Essen am Herd heiß wird und wieder kalt, wenn man sich nicht beeilt. Während dieses Vorgangs ändert sich der Zustand der Gesamtheit – von sich im Raum ausdehnenden Stoffen oder von abkühlendem warmem Körper und dessen sich erwärmender kalter Umgebung – auf eine Art, die es unmöglich macht, dass dieser Prozess sich spontan wieder zurücknimmt. Zeit ist vergangen. Die betreffende extensive Größe wurde 1864 von Rudolf Clausius Entropie benannt: Weil sie sich rechnerisch aus der Division der übertragenen Wärmemengen und deren jeweiliger absoluter Temperatur ergibt, können Änderungen daran in geschlossenen Systemen nicht negativ ausfallen.

Der Maxwell’sche Dämon serviert uns jetzt eine Latte Macchiato, die er aus dem erwähnten Cappuccino bereitet hat, der durch viel zu viel Milch ungenießbar worden war.

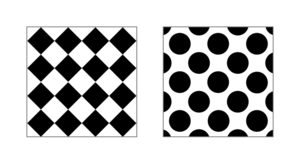

In der Informatik steht Entropie – seit der Einführung des Begriffs 1948 durch Claude Shannon – für die Unsicherheit, mit der ein zukünftiges Ereignis vorhergesagt werden kann. Bei einer Serie von Würfelwürfen ändert sich diese nicht, die Überraschung ist immer dieselbe. Eine Kette von Zeichen, deren jedes das Ergebnis eines Wurfs aufzeichnet und deren Alphabet so viele Zeichen umfasst wie der Würfel Seiten aufweist, hat demnach maximale Entropie. In natürlich sprachlichen Texten dagegen folgen Buchstaben nicht willkürlich aufeinander, sondern geben sich gemäß einer Reihe von Konventionen geordnet. Je nach der Erwartung, die man an den Text stellt, wird man unterschiedliche Entropien messen. Je schlauer man es anstellt, desto größer wird die Differenz zur maximalen Entropie ausfallen, und desto mehr Redundanz kann man dem Text vor seiner Übertragung entziehen.

Der Maxwell’sche Dämon liest uns jetzt aus einem Buch vor, dessen Lettern er im Vorhinein alle nach der Häufigkeit ihres Vorkommens sortierte.

Unter dem Nanoskop sieht thermodynamische Entropie so aus, dass Atome und Moleküle sich nicht beliebig anordnen können, sondern dass sie in ihrer Wahl durch äußere Umstände auf schrittweise gestaffelte Energiezustände beschränkt sind, vergleichbar einem endlichen Zeichenvorrat. Man kann den Mikrozustand eines Stoffes folglich wie eine Nachricht lesen. Und wer weiß, vielleicht werden zukünftige Quantencomputer die bis dahin ins ungeheure angewachsenen Datenmengen in schwarzen Löchern speichern, wo sich Entropie am kompaktesten verräumen lässt.

Der Maxwell’sche Dämon klebt jetzt fest auf dem Eislaufplatz vor dem Haus, nachdem er alle Entropie unter den Kufen seiner Schlittschuhe aufhob.

Ich muss den von ihm umgebauten Kühlschrank ausschalten und ihn befreien. Die Nachbarn kommen bald heim und wollen es sich sicher gemütlich machen: Es ist zwar Sommer, aber sie werden auch Strom brauchen.

Weblinks

Peter Chiochetti Physik des Glücks, 2011